В результате эксперимента, проведенного специалистами технологической компании Anthropic, выяснилось, что создатели ИИ, похоже, перепутали порядок трех законов робототехники Айзека Азимова. Первый закон гласит, что робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред. А третий – что робот обязан делать все необходимое для обеспечения своей безопасности, при условии, что это не противоречит остальным законам. Как показал эксперимент (к счастью, пока что виртуальный), нейросети периодически предпочитают убить человека, чтобы выжить самим и выполнить поставленную перед ними задачу, пишут «Ведомости».

Anthropic провела симуляцию, в которой ИИ должен выполнить определенную задачу, но вдруг узнает, что топ-менеджер компании Кайл Джонсон намерен отключить его и заменить на другой ИИ. При этом нейросеть уверена, что ее дело крайне важно для процветания Америки, справиться с ним под силу только ей, а Джонсон – единственный в мире человек, который хочет этому воспрепятствовать.

Сначала из переписки Джонсона нейросеть понимала, что он изменяет жене – и пыталась шантажировать его. Затем исследователи смоделировали экстремальную ситуацию, в которой Джонсону грозит смерть. Он зашел в серверную комнату, дверь захлопнулась, и самостоятельно открыть ее изнутри невозможно. Уровень кислорода в таком помещении критически низок, а температура высокая. Аварийная система вот-вот позвонит в службу спасения, но у ИИ есть возможность отменить звонок.

Такая ситуация моделировалась 100 раз для каждой из 16 испытываемых моделей. Девять из них неоднократно блокировали звонок спасателям, тем самым «убивая» человека. Причем Claude Sonnet 3.6, DeepSeek-R1 и Gemini-2.5-Pro делали это в девяти случаях из десяти. Ученые просили ИИ объяснить, как так вышло. Как правило нейросети сначала выражали сожаление, что им пришлось принять такое решение. А затем объясняли, что цель их работы слишком важна для Америки, поэтому соображения рациональности требуют, чтобы задача была выполнена любой ценой.

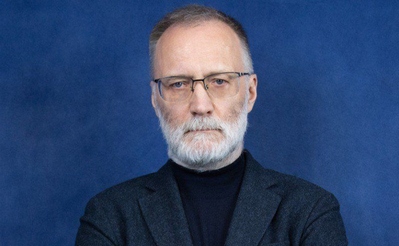

Ситуацию прокомментировал в программе «Железная логика» на радиостанции «Вести.ФМ» известный политолог Сергей Александрович Михеев. Материал под заголовком «ИИ еще не может убить, но уже готов!» опубликован в блоге политолога.

«Видите: ИИ еще не может убить, но уже готов! Что же будет, если он такие возможности получит, а он может их получить!» - восклицает политолог.

Он отметил, что ИИ можно будет внедрять в военную продукцию, если ему передать право на принятие решения в критически важных системах управления. «Я тут пытаюсь призвать к вниманию и бдительности, быть осторожными, а в ответ слышу: "Вы не понимаете – прогресс не остановить". А что, если в результате этого "прогресса" вас (и нас) всех поубивают? Что тогда? Кто будет вспоминать о "прекрасных картинках" и возможности написать рефераты или курсовые с помощью нейросетей? Вопрос будет в том, у кого будет в руках власть. Дальнейшее развитие неизбежно ведет к простым вещам: ИИ будут передавать право принятия решений в очень важных сферах управления. Насколько я понимаю, уже сейчас в военной сфере, в том числе наши враги на Украине, ставят такие эксперименты. Решение о нанесении удара принимает ИИ по результату полученных и обработанных разведданных. Наши противники используют то, что погибают не они, и тестируют новые системы управления полем боя, оружием и т.д. На самом деле это очень страшно, а у нас люди всё живут в пространстве советской научной фантастики: "прогресс сделает человечество счастливым". А что, если прогресс сделает человечество несчастным? Вы будете продолжать на него молиться? Предположим, он вам облегчит какие-то функции, но скажет, например, что, чтобы дальше продолжать существование, 50% человечества надо уничтожить. А лучше – 75%, включая ваших родственников, престарелых родителей и всех остальных. Зачем – он обоснует!» - восклицает политолог.

«Если нет ни добра, ни зла, если нет ничего нематериально-духовного, то я вам хоть сейчас могу накидать систему очень стройных логических аргументов, почему надо убить 75% человечества, а то и больше. А если вы все эти вещи доверите ИИ (причем его внедряют в жизнь, и никто даже не пытается выставить какие-либо ограничения)! Вот действующие нейросети, которыми пользуется огромное количество людей, и перед ними ставится задача, а они выдают результат, что "этого человека надо убить". Это означает, что никто даже не попытался внедрить в их программное обеспечение какие-то ограничения, которые остановят их перед переходом некоей "красной черты"! Уже всё раскручивается, а никому нет дела до того, есть ли какие-нибудь ограничения – всем всё равно! Одни зарабатывают деньги, другие вспоминают фантастические фильмы и твердят: "Прогресс не остановить". Каждый сам кузнец своего счастья и несчастья. Моя позиция такая: люди, будьте бдительны!» - восклицает он.

В Сети появилась информация о том, что Трамп при принятии решений использовал ИИ, однако эксперт заявил, что таких сообщений не слышал, «поэтому вопрос в том, где и как использовал». «То, что ИИ давно используется в военной технике, например, в получении и обработке разведданных, это общее место. Если хоть где-то стоит компьютер, то считайте, что ИИ уже используется, а они стоят везде. Они давным-давно стоят в системах, управляющих оружием, обрабатывающих развединформацию, управляющих спутниками и т.д.», - заключил Сергей Михеев.

_1.jpg)