1 и 2 ноября в Великобритании проходит первая глобальная конференция по вопросам искусственного интеллекта. В мероприятии принимают участие представители правительств разных стран, лидирующих компаний и экспертов в области ИИ.

Страны-участницы конференции достигли соглашения о понимании возможностей и рисков, связанных с технологиями искусственного интеллекта, говорится в заявлении, опубликованном на сайте британского правительства, сообщает РИА Новости.

«Сегодня, в среду 1 ноября 2023 года, приглашенные Великобританией ведущие страны в сфере ИИ, включая США и Китай, а также Европейский союз, достигли в Блетчли-парк соглашения, устанавливающего общее понимание возможностей и рисков, создаваемых передовым ИИ, а также необходимость совместной работы правительств для решения наиболее важных задач», - сказано в тексте.

В число стран, поддержавших декларацию, входят Бразилия, Индия, Ирландия, Кения, Саудовская Аравия, Нигерия, Украина, Объединенные Арабские Эмираты, Франция и Япония.

Декларация предполагает укрепление международного научного сотрудничества в выявлении рисков и возможностей ИИ. Кроме того, страны намерены адаптировать политику к потенциальным угрозам от ИИ, создавая инструменты для борьбы со злоупотреблениями технологией ИИ. Так, предполагается повышение прозрачности разработок передовых ИИ, использование инструментов тестирования, создание механизмов оценки.

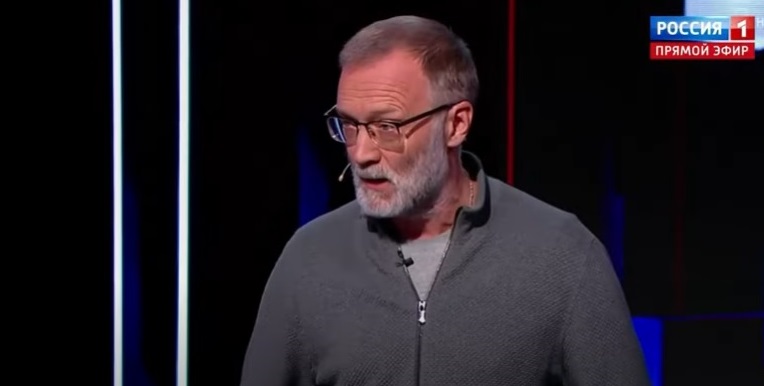

Известный политолог Сергей Михеев в эфире программы «Железная логика» на радио ВестиФМ, комментируя проведение конференции по вопросам искусственного интеллекта, отметил, что «эта конференция проходит в Великобритании; делегация, в основном, из стран G7. Звали Китай, но не знаю, поехал он или нет. Западная цивилизация запустила процесс романтизации ИИ, его восхваления, рассказывая о том, что "это будущее". Но не прошло и несколько лет, а уже надо собирать конференцию по безопасности: с ИИ страшно, и неизвестно, что он натворит. Вы не могли подумать об этом, когда всё запускали? Хотел бы нашим энтузиастам ИИ сказать: посмотрите, инициаторы торжества ИИ уже вынуждены проводить конференцию. Будут обсуждать, как сделать так, чтобы развитие ИИ не несло угрозу человечеству. Когда все кидаются в "бурные волны", покупаясь на модные призывы, то надо бы подумать о безопасности».

«Когда экстремальные виды спорта, то говорят: "Не забудьте о безопасности. Не забудьте надеть спасжилет. Не пытайтесь повторять это самостоятельно". Почему? Потому что ваше стремление получить острое ощущение может кончиться смертью или, в лучшем случае, тяжёлой травмой, - напомнил он. - Сначала выучи технику безопасности, а потом всё остальное. Я когда-то долго занимался дельтапланеризмом: пока не поймешь азов, не выучишь технику безопасности и оказание медицинской помощи, до полетов не допускали. А здесь говорят: "Летим! Искусственный интеллект!" Прошло чуть-чуть - и надо уже заботиться о безопасности. Насчёт того, подошло ли человечество куда-то или не подошло, мне судить трудно. Есть опасения, что гонка в использовании ИИ может привести к его бесконтрольному развитию и внедрению его в те отрасли жизни, которые связаны с безопасностью людей».

«Например, если ИИ будут доверять контроль за подачей электроэнергии, за водоснабжением, или, не дай Бог, за военными системами, то это может быть теоретически чревато тем, что в какой-то момент ИИ выйдет из-под контроля и начнет принимать решения, которые вместо того, чтобы приносить пользу, будут разрушать. Возможно это? Возможно. Потому что контроля за ним нет: ИИ сначала развивали, а потом начали думать о безопасности. Насколько я понимаю, пока такой критической черты нет. Мы не подошли к критической черте, потому что, в основном, ИИ забавляются в разных сферах, не связанных напрямую с жизнеобеспечением. Может быть, ещё не поздно подумать о безопасности», - предположил политолог и добавил, что трактовка по поводу этой конференции - это «попытка стран Запада застолбить за собой лидерство в развитии ИИ, но так, чтобы не споткнуться по дороге. Больше всего они боятся отстать от Китая или еще от кого-нибудь в этом деле, поэтому собираются для проформы. Я до сих пор не понимаю, о чём идёт речь...».

«Это коллективный интеллект, который пытается сочетать программы. Является ли это искусственным интеллектом, чем-то абсолютно самостоятельным? Это будет тогда, когда он выдаст что-то такое, чего человеческий интеллект не выдавал никогда», - полагает эксперт.

По его мнению, «пока это просто "перетасовка карт". Если такой программе доверять управление жизненно важными процессами, то мы не понимаем, что она может выдать. Есть какой-то алгоритм, и те, кто его создавал, понимают, чему она отдаст предпочтение в том или ином случае. Но если есть ситуация, при которой ее реакция может быть непредсказуемой, это будет опасно. Опасной точкой станет момент, когда вы не сможете предсказать ее реакцию. В некоторых случаях уже сейчас создатели не могут этого сделать. А если вы не можете предсказать реакцию на 100%, тогда программа становится неуправляемой и может нести опасность. Об этом, конечно, надо думать. И не надо доверять им то, что доверять нельзя. Например, что касается здоровья, жизни и жизнеобеспечения людей. Считаю, что к этому мы пока совершенно не готовы».

_1.jpg)